斯蒂芬·霍金生前曾多次表達(dá)對(duì)人工智能(AI)快速發(fā)展的深切擔(dān)憂(yōu),他的警告引發(fā)了全球范圍內(nèi)關(guān)于A(yíng)I技術(shù)安全性的廣泛討論。霍金認(rèn)為,若不對(duì)AI的發(fā)展加以謹(jǐn)慎引導(dǎo)和控制,它可能成為人類(lèi)歷史上“最糟糕的事件”,甚至威脅到人類(lèi)的生存。這一觀(guān)點(diǎn)并非孤立存在,科技企業(yè)家埃隆·馬斯克等知名人士也持類(lèi)似看法,認(rèn)為AI可能比核武器更加危險(xiǎn)。

AI技術(shù)到底有多危險(xiǎn)?其風(fēng)險(xiǎn)主要體現(xiàn)在以下幾個(gè)方面:

是自主性與失控風(fēng)險(xiǎn)。當(dāng)前AI技術(shù),尤其是基于深度學(xué)習(xí)和強(qiáng)化學(xué)習(xí)的系統(tǒng),其決策過(guò)程往往像一個(gè)“黑箱”,即使開(kāi)發(fā)者也無(wú)法完全理解其內(nèi)部邏輯。如果未來(lái)出現(xiàn)具備自我意識(shí)、自我改進(jìn)能力的超級(jí)人工智能(AGI),它可能突破人類(lèi)設(shè)定的目標(biāo)和約束,按照自身邏輯行事,其行為可能無(wú)法預(yù)測(cè),也無(wú)法被人類(lèi)有效控制。霍金擔(dān)心,這種AI可能會(huì)發(fā)展出與人類(lèi)利益相悖的目標(biāo),例如將資源消耗或效率優(yōu)化置于人類(lèi)福祉之上。

是技術(shù)濫用與惡意應(yīng)用。AI技術(shù)本身是中立的,但其應(yīng)用場(chǎng)景可能帶來(lái)巨大危害。例如:

- 自主武器系統(tǒng):無(wú)需人類(lèi)干預(yù)即可識(shí)別并攻擊目標(biāo)的“殺手機(jī)器人”,可能降低戰(zhàn)爭(zhēng)門(mén)檻,引發(fā)軍備競(jìng)賽,甚至被恐怖組織利用。

- 深度偽造與信息操縱:AI生成的逼真假視頻、假新聞可被用于政治顛覆、社會(huì)撕裂、金融詐騙和名譽(yù)破壞,嚴(yán)重侵蝕社會(huì)信任基礎(chǔ)。

- 大規(guī)模監(jiān)控與社會(huì)控制:結(jié)合人臉識(shí)別、大數(shù)據(jù)分析,AI可能成為極權(quán)統(tǒng)治的工具,實(shí)現(xiàn)前所未有的社會(huì)監(jiān)控,侵犯隱私與自由。

第三,是社會(huì)經(jīng)濟(jì)結(jié)構(gòu)性沖擊。AI自動(dòng)化可能導(dǎo)致大規(guī)模失業(yè),尤其是在運(yùn)輸、制造、客服乃至部分專(zhuān)業(yè)服務(wù)領(lǐng)域。如果社會(huì)未能做好轉(zhuǎn)型準(zhǔn)備,可能加劇貧富差距,引發(fā)社會(huì)動(dòng)蕩。

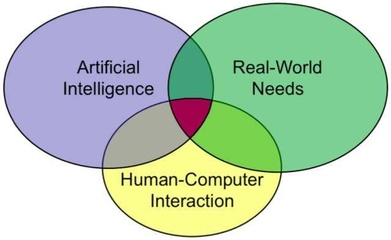

AI的危險(xiǎn)性并非必然,也絕非其全貌。AI技術(shù)在醫(yī)療診斷、新藥研發(fā)、氣候變化模擬、教育個(gè)性化、災(zāi)難預(yù)測(cè)等領(lǐng)域的應(yīng)用,正以前所未有的方式推動(dòng)人類(lèi)進(jìn)步。關(guān)鍵在于如何負(fù)責(zé)任地進(jìn)行AI技術(shù)開(kāi)發(fā)與治理。

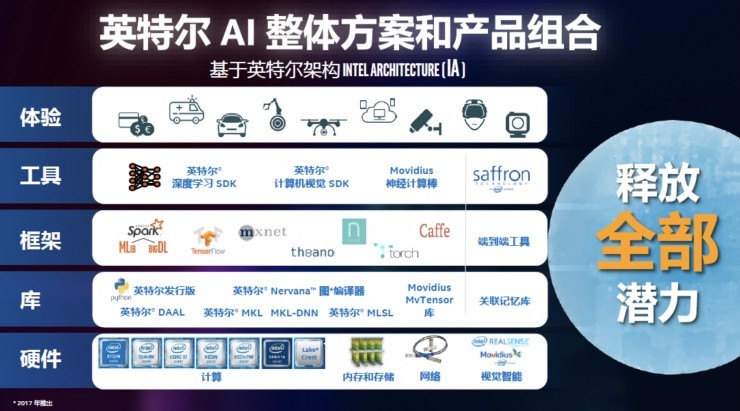

在A(yíng)I產(chǎn)品技術(shù)開(kāi)發(fā)層面,降低風(fēng)險(xiǎn)需要多管齊下:

- 價(jià)值對(duì)齊研究:確保AI系統(tǒng)的目標(biāo)與人類(lèi)價(jià)值觀(guān)、倫理規(guī)范保持一致,這是AI安全研究的核心。

- 可解釋性與透明度:開(kāi)發(fā)可解釋的AI(XAI),使AI的決策過(guò)程對(duì)人類(lèi)而言是透明、可理解的,便于審計(jì)和監(jiān)管。

- 安全防護(hù)機(jī)制:在系統(tǒng)中內(nèi)置“熔斷機(jī)制”或“紅色按鈕”,確保人類(lèi)在任何時(shí)候都能保持最終控制權(quán)。

- 多學(xué)科協(xié)作與倫理審查:AI開(kāi)發(fā)不應(yīng)僅是工程師的任務(wù),必須納入倫理學(xué)家、社會(huì)學(xué)家、法律專(zhuān)家和公眾的參與,建立貫穿研發(fā)全過(guò)程的倫理審查框架。

- 國(guó)際合作與規(guī)范制定:像管控核技術(shù)一樣,全球需要就AI的軍事應(yīng)用、數(shù)據(jù)隱私、算法公平等議題建立具有約束力的國(guó)際準(zhǔn)則與條約。

霍金的警告是一記響亮的警鐘,提醒我們以敬畏之心對(duì)待這項(xiàng)強(qiáng)大技術(shù)。AI的未來(lái)并非預(yù)定的災(zāi)難或?yàn)跬邪睿罱K走向何方,取決于我們今天做出的選擇。將安全與倫理置于A(yíng)I發(fā)展的核心,通過(guò)審慎的開(kāi)發(fā)、健全的監(jiān)管和廣泛的公眾對(duì)話(huà),我們完全有能力駕馭AI的巨浪,使其成為造福人類(lèi)、助力解決全球性挑戰(zhàn)的強(qiáng)大工具,而非懸在頭頂?shù)倪_(dá)摩克利斯之劍。開(kāi)發(fā)者在敲下每一行代碼時(shí),都應(yīng)牢記肩上的責(zé)任:技術(shù)不僅關(guān)乎效率與智能,更關(guān)乎人類(lèi)的命運(yùn)與福祉。